walito escribió:Yo, lo que sinceramente no me acabo de creer, es que las líneas de la gráfica sean completamente rectas y lineales con la distancia.

Sería bueno una tabla de 0 a 5 metros máximo, y seguramente habría una curva (logaritmica probablemente...).

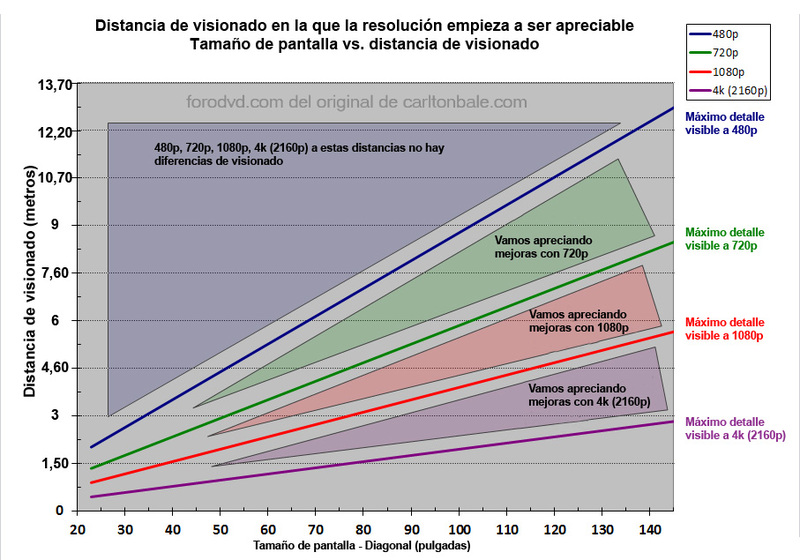

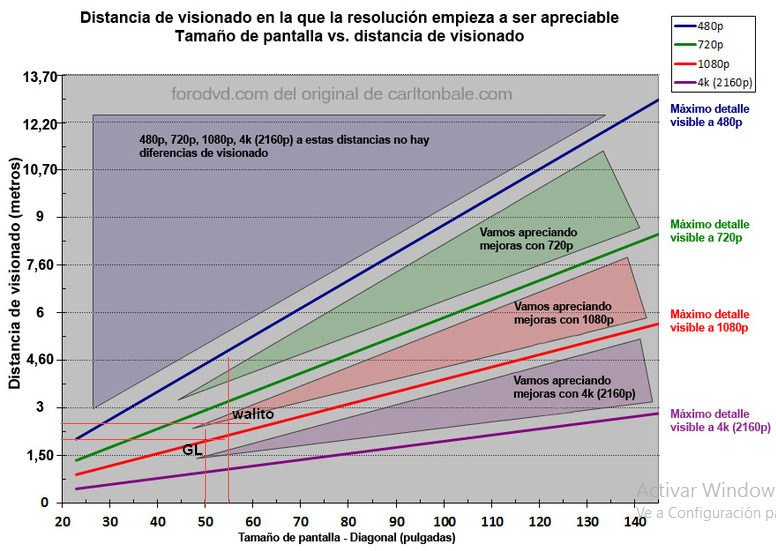

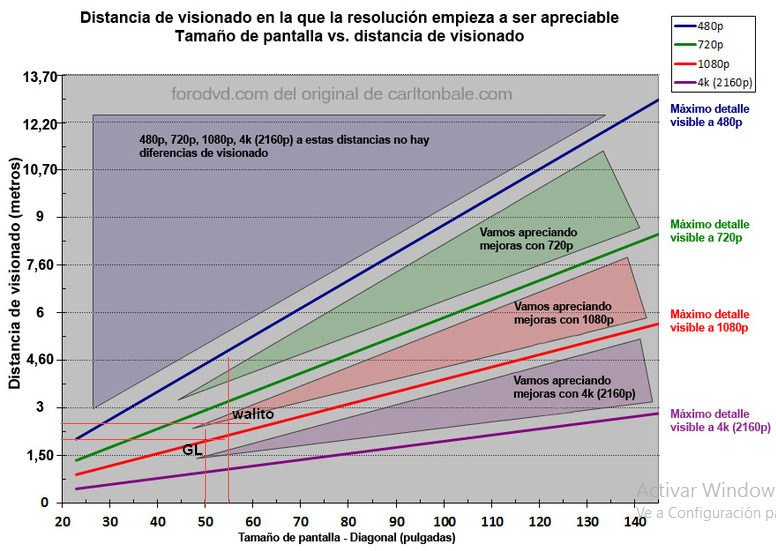

La gráfica es un modelo, y además bien fundamentado. Yo sí creo que las líneas de igual percepción de detalle sean rectas con la distancia (salvo que el ojo rinda mejor en función de la distancia de enfoque, lo cual no es ninguna tontería porque le ocurre a las lentes).

Sea como sea, el problema llega cuando uno no sabe lo que es un modelo y lo interpreta como una realidad trasladable a rajatabla al mundo real. A mí ese modelo me sirve para saber una cosa: que la mejora entre Full HD y 4K no va a ser en ningún caso abismal a las distancias de uso habituales en el hogar, pero

no me sirve para saber que será nula. De hecho mirando lo ajustado que van los límites del modelo para tu uso y el que yo comenté (2m con 50" o 2,5m con 55"), y sin haber mirado una tele 4K, estimo que sí habrá mejora, y creo lo que dices.

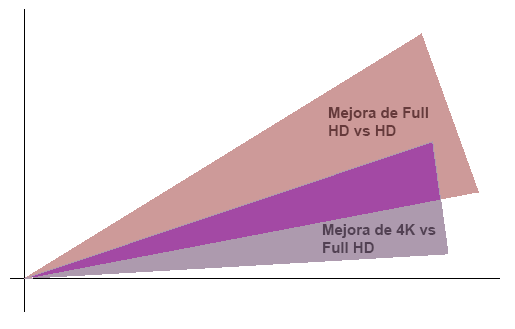

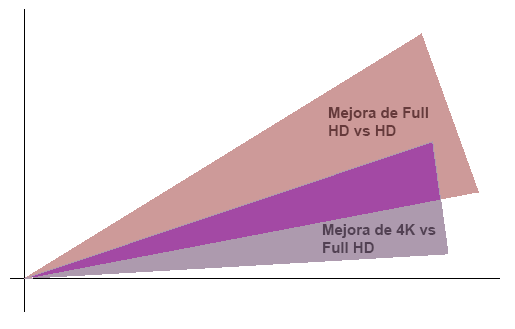

La realidad intuyo que es mucho más similar a este comportamiento:

Como decía el sistema visual es continuo, y por tanto progesivo, con lo que lo lógico es pensar que haya solapes: es decir, que a una distancia/pulgadas donde el 4K ya empieza a mostrar una mejora vs Full HD (y ese "empieza" es totalmente difuso y dependerá de mil variables), al Full HD aún le quede margen para incrementar su mejora vs HD. Es absurdo pensar que sistemas continuos generen límites abruptos.

Lo mismo ocurre con los modelos (ecuaciones de Rayleigh) para decidir a qué f una óptica está limitada por difracción; la difracción no llega de forma abrupta, antes de ese f ya empezó a asomar, pero se modela un límite soportable. Pau está diciendo: por debajo de f/8 cero difracción, a f/8 y superiores la ruina total!. Y no es así, a f/7,1 ya hay difracción, pero menos que a f/8, y a f/11 hay más difracción que a f/8.

Salu2!